Як упередження було виявлено та вирішено шляхом збору даних і анотації

Самі по собі комп’ютери та алгоритми не є фанатичними чи упередженими. Вони лише інструменти. Фанатизм — це помилка людей. Упередження в штучному інтелекті зазвичай виникають через використання невеликих наборів даних. Це було виявлено в перших алгоритмах розпізнавання обличчя та вирішено за допомогою інноваційних даних і використання більших наборів даних. Відомо, що ранні технології розпізнавання обличчя здавалися фанатичними, оскільки вони краще розпізнавали обличчя білих чоловіків середнього віку та азіатів, як і тих, хто їх фінансував і створював.

Деяка більша та обґрунтована соціальна критика щодо причин упередженості все ще існує. Причина полягала не в тому, що компанії були фанатизовані. Справжня причина полягала в тому, що набори даних, які використовувалися для навчання штучного інтелекту ранніх систем розпізнавання облич, були занадто малими. Не було достатньо збору даних і анотацій, щоб зробити хорошу роботу.

Це також означало, що дані були недостатньо вичерпними. Також були проблеми з освітленням і з деякими знімками. Нарешті, були апаратні проблеми з роботою перших цифрових камер. Ці недоліки просто не були помічені, доки ці цифрові камери не вийшли на ринок.

Ринок відкрив для перших цифрових камер більший набір даних. Усвідомивши проблеми, виробники запропонували інноваційні рішення. Однак ці проблеми з апаратним забезпеченням були досить стійкими, щоб вплинути на набір даних, використаний для створення першого штучного інтелекту для розпізнавання облич. Ця проблема виникла ще до появи першого штучного інтелекту для розпізнавання облич. Передбачувана упередженість людей, які це зробили, не була якимось чином закодована в цих алгоритмах.

Ми всі повинні усвідомлювати, що кожен хоче мати можливість робити гарні фотографії всіх і розпізнавати обличчя кожного. Хороші компанії хочуть мати можливість продавати всім, хто може купити їхні продукти та послуги.

Технології не можуть вирішити всі великі соціальні проблеми. Це не завжди правильний інструмент. Проблему цифрових фотоапаратів, які не роблять найкращих знімків для всіх, вирішено. Також вирішено проблему розпізнавання обличчя, яке працює не для всіх. Рівень точності сучасного штучного інтелекту розпізнавання облич зараз становить 99,8%. Решта 0,02% походять від травм, старіння та інших змін зовнішнього вигляду.

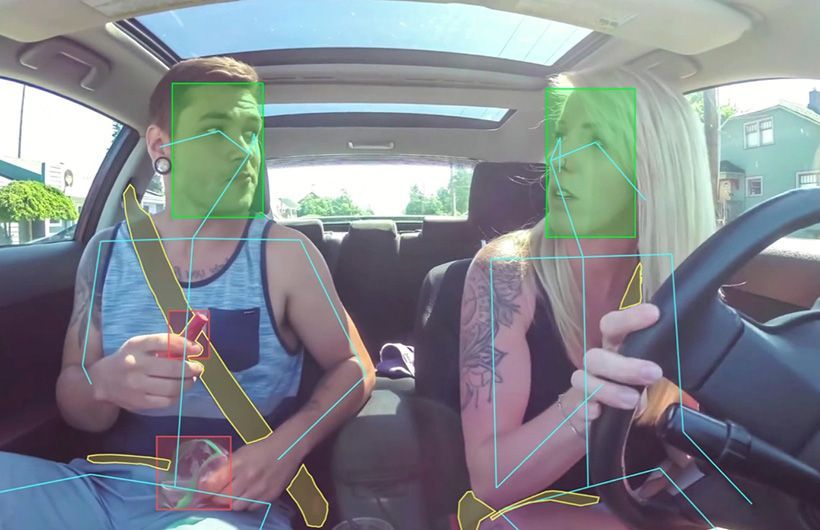

Це було досягнуто шляхом розширення наборів даних, які використовуються для навчання ШІ та алгоритмів машинного навчання.

Збір відеоданих для машинного навчання значно просунувся за останні 10+ років, відколи ця проблема була відома. Велика соціальна проблема фанатизму в суспільстві все ще існує. Але ці більші соціальні проблеми відрізняються. Проблеми упередженості в ШІ є технічними проблемами. Ці проблеми можна вирішити набагато легше. Технологічний прогрес випереджає соціальний прогрес. Люди та ШІ, працюючи разом, можуть пом’якшити більші соціальні проблеми.

Алгоритми складаються з правил. Вони не можуть порушувати правила!

Алгоритм — це набір правил, за допомогою яких комп’ютер розв’язує задачі. Штучний інтелект – це свого роду алгоритм. Хороші технологічні компанії не просто продають продукти та послуги. Вони продають рішення проблем. Найкращі рішення проблем, про які ви, можливо, не підозрювали. ШІ не може бути фанатиком. Він також не може порушувати правила, з яких він створений. Це вірно навіть тоді, коли він може вчитися і мислити так, як не може мислити людина. Отже, ми навряд чи вітаємо будь-яких роботів-володарів.

Ось чому не всі люди будуть позбавлені роботи через ШІ. ШІ може не бути фанатичним і, наприклад, відмовити в заявці на позику через фанатизм, але можуть виникнути ті самі несправедливі результати. Служби збору даних зображень, кращі цифрові камери та інші технології не можуть вирішити цю проблему. Отже, хороші компанії можуть робити правильні речі, запрошуючи людей, які мають повноваження приймати рішення, працювати з ШІ та робити винятки з правил.

Людина та ШІ перевіряють роботу один одного та вчаться один у одного. Коли той самий несправедливий результат все одно трапляється, людина все одно повинна мати можливість виправити це. Якщо люди чинять неправильно через невідомі неявні упередження, це не робить їх поганими людьми.

Є багато цікавих випадків використання, коли штучний інтелект може виявити це неявне упередження, і люди можуть навчитися на цьому та стати кращими. Звичайно, технології не можуть вирішити більші системні соціальні проблеми, але вони можуть допомогти.

Види зміщення в ШІ

- Системний фанатизм і упередженість. Компанія не хоче бути фанатизованою. Це все ще вбудовано в суспільство. Таким чином, система все ще залишається упередженою та надає перевагу одним перед іншими.

- Упередженість автоматизації - Надмірна залежність від ШІ змушує людину приймати неправильні рішення.

- Упередженість вибору - Дані недостатньо великі або належним чином рандомізовані.

- Переобладнання та недооблаштування даних. Переобладнання — це коли алгоритм навчається на основі занадто великої кількості шуму в даних, а недостатнє — це коли він не вчиться на основі тенденції в даних.

- Упередження у звітах. Це може бути лише перегляд даних вашою рідною мовою, надання переваги лише даним, використаним у цитатах інших осіб, лише вибір даних із «позитивними», а не негативними результатами, або надання даних, які підтверджують бажаний висновок, а не точні. результат.

- Упередження надмірного узагальнення - застосування чогось із одного особистого досвіду спілкування з членом групи до всіх членів цієї групи.

- Групові упередження. Вони можуть виглядати так, ніби віддають перевагу власній групі або застосовують стереотипи до групи, до якої ви не належите.

- Неявні упередження - несвідомі упередження, про які люди не знають, але впливають на наші рішення. Це не робить нікого фанатиком чи злом за своєю суттю, і може бути незручно дізнаватися, що ти є таким, коли це розкривається.

- Упередженість підтвердження - «Коли ви сказали мені про упередженість підтвердження, я почав бачити це всюди». є кумедним прикладом упередженості підтвердження.

Ключові висновки

Зміщення в штучному інтелекті – це лише технічна проблема, яку можна вирішити за допомогою науки та техніки. Упередженість людей і суспільства є більшою соціальною проблемою, яку набагато важче вирішити. Критики можуть сказати, що упередженість ШІ надає нового значення таким фразам, як «системний расизм». Але хороші компанії не хочуть, щоб їх фанатизували. Вони лише хочуть заробити всі гроші, які можуть, виробляючи найкращі продукти та продаючи свої продукти та послуги всім.

Одне з найкращих рішень для упередження штучного інтелекту – піддавати алгоритми набагато більшим і різноманітнішим наборам даних. Компанії повинні масштабувати збір даних і анотації, щоб вони були якомога всеохопнішими.